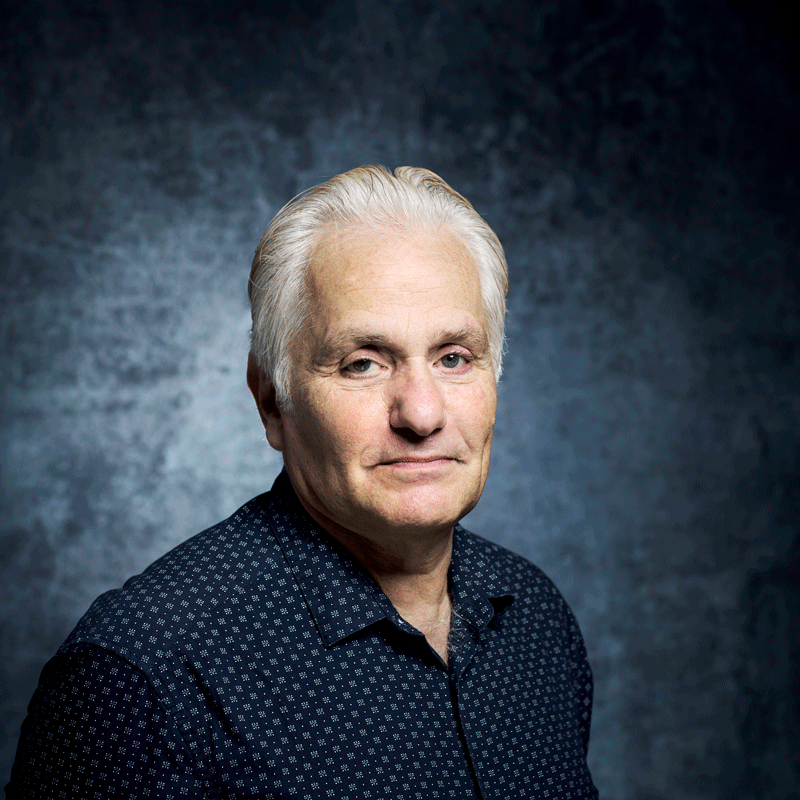

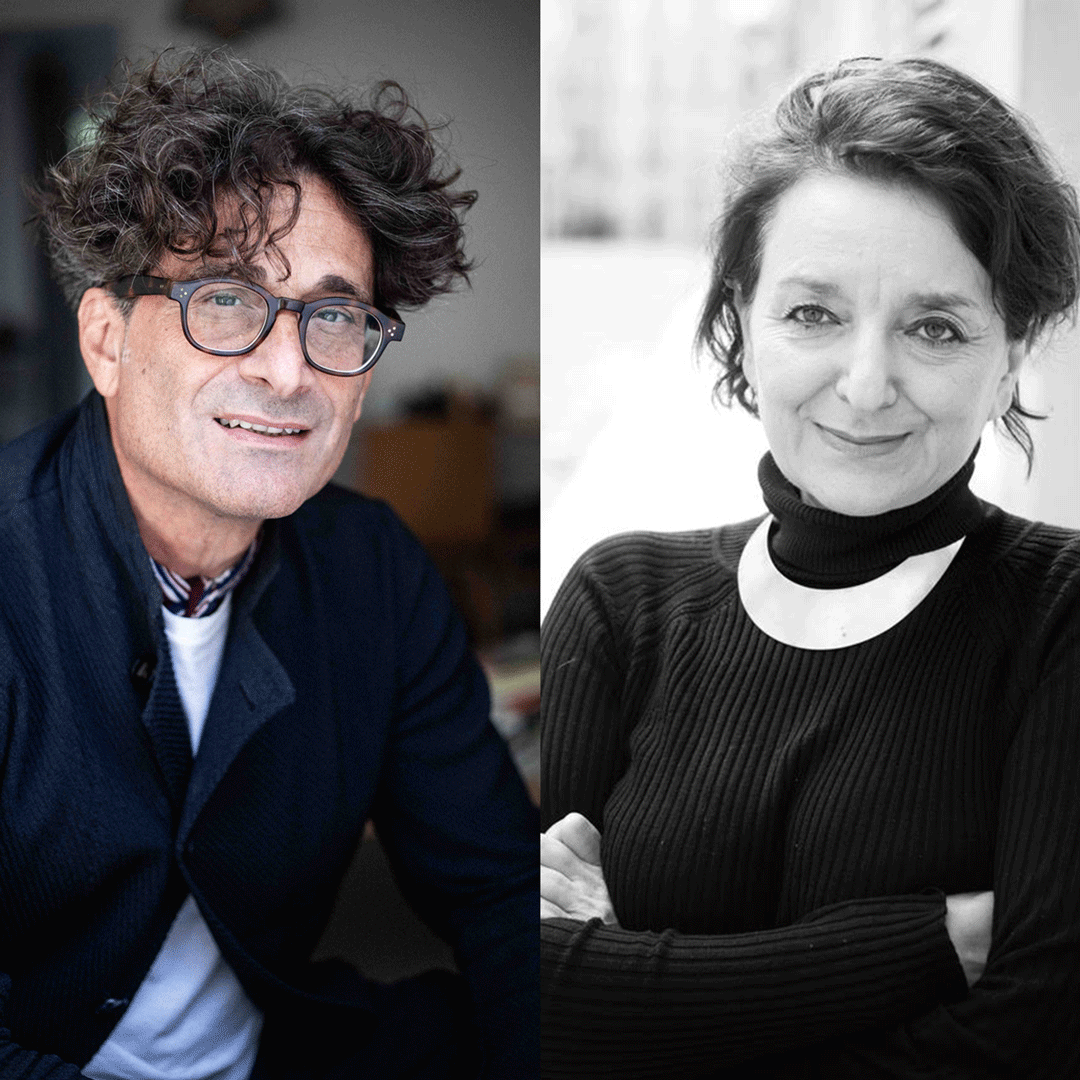

Entretien de Lucie Spindler avec Raphael Grably, rédacteur en chef adjoint à BFM Business, en charge de Tech and Co et de la tech sur BFMTV.

Après l’explosion à l’hôpital Al-Ahli de Gaza, vous avez écrit sur X (anciennement Twitter) que cet événement est “un défi inédit en matière de vérification de l’info”. Pourquoi?

Il y a eu un mélange assez inédit. D’une part, on a vu une profusion d’informations qui peut être assez positive. De nombreuses vidéos ont été mises en ligne très rapidement sur X et diffusées partout. Ces vidéos, après vérification, sont des outils indispensables pour mener une enquête en sources ouvertes. Les enquêtes en sources ouvertes utilisent les ressources librement accessibles en ligne pour essayer d’enquêter sur un sujet. C’est ce que font beaucoup de journalistes. Ils peuvent voir une vidéo, regarder l’horodatage de cette vidéo, ensuite aller comparer sur Google Maps pour voir si les bâtiments ont la même forme,pour confirmer que c’est au bon endroit. Ces techniques d’enquête en sources ouvertes s’appuient sur la diffusion massive d’informations.

Mais il faut aussi souligner le côté négatif de cette profusion d’informations : la nouvelle politique de X permet à n’importe qui d’acheter un badge de certification et donc il est très compliqué de savoir qui est sérieux ou pas. Auparavant, les badges de certification étaient donnés par Twitter avec un processus sélectif, que ce soit pour des personnalités militantes ou journalistiques. Il y avait une sorte de gage de sérieux. Là, tout le monde peut acheter son badge. Donc même les journalistes sérieux se font intoxiquer. Cela provoque une réaction en chaîne. Et une fois qu’il y a un journaliste sérieux qui est intoxiqué, il intoxique tous les autres, puisqu’il est réputé sérieux.

Donc on a assisté à une crise de confiance totale dans les comptes, mais aussi une profusion d’informations, qui m’ont fait dire à ce moment‐là qu’on était dans un événement particulier et qu’il était impossible d’émettre le moindre jugement. Par contre, plusieurs médias dont Le Monde, Libération, le Guardian ont réussi à faire des enquêtes en sources ouvertes. Sans dresser d’analyse totalement définitive, ils ont réussi à montrer que les informations circulant initialement étaient probablement fausses.

Ces mécanismes sont amplifiés par des biais de confirmation. On est enfermés de façon algorithmique dans des bulles de filtres. On voit ce qui va dans notre sens et donc on est persuadés d’avoir raison tout de suite. C’est pour cela qu’on a vu des tweets de politiques qui ont tout de suite repris une version en étant persuadés que c’était la bonne. Une fois que vous avez des députés qui reprennent l’information, beaucoup de personnes se disent qu’elle est forcément vraie.

Selon vous, pourquoi les plateformes ne jouent-elles pas leur rôle de modération dans cette guerre informationnelle? Est-ce un problème de moyens humains ou une volonté politique?

Les deux existent et parfois de manière cumulée. Je pense que du côté de Facebook, Youtube, TikTok, ce sont essentiellement des questions financières. Youtube et Facebook font tout de même des efforts. Mais il faut se rendre à l’évidence : sur un réseau social avec un ou deux milliards d’utilisateurs, même avec beaucoup de modérateurs humains, ce n’est pas possible de modérer et donc ils se reposent sur des algorithmes. Or ces algorithmes sont extrêmement imparfaits et laissent passer beaucoup de choses. Si vous avez 10 milliards de contenus publiés dans une journée et que vous en laissez passer 1%, cela fait quand même beaucoup de contenus. C’est valable pour les fausses informations, mais surtout pour les images violentes qu’on a vu après l’attaque du Hamas et qui sont toujours en ligne.

Twitter c’est un cas particulier, parce que c’est à la fois un manque de moyens humains (Elon Musk a licencié quasiment toutes les équipes de modération) et à la fois une volonté de ne pas modérer. Cela les arrange bien financièrement, leur permettant de justifier leur absence de modération. Mais eux, ils assument. Ils laissent volontairement des vidéos qui sont illicites (avec parfois des corps sans vie)… Ils ne veulent pas modérer et c’est pour cela qu’il y a un conflit avec l’Union Européenne. Il y a une enquête en cours qui concerne Twitter (mais aussi Meta et Tik Tok). Twitter est particulièrement ciblé par Bruxelles.

Comment se déploie la guerre informationnelle sur les réseaux sociaux? Quels moyens numériques sont utilisés par le Hamas et par Israël?

Des deux côtés, il y a des outils qui sont utilisés. Le Hamas utilise la terreur puisque c’est un mouvement terroriste qui cherche à terroriser. Comment on terrorise ? En montrant des vidéos de gens qui se font massacrer et des cadavres. Cela passe d’abord par Telegram, car sur Telegram il y a peu de modération. Elles sont ensuite rediffusées par des soutiens du Hamas mais aussi paradoxalement par des soutiens d’Israël, et notamment par une partie de l’extrême-droite française. Ils les présentent comme des vidéos qu’il faudrait voir pour comprendre ce dont le Hamas est capable mais évidemment sans traitement journalistique, sans précautions qui consisteraient à prévenir, à flouter, à préserver la dignité des victimes et à ne pas simplement servir la propagande du Hamas. On retrouve ces vidéos de propagande soit par des islamistes, soit par l’extrême-droite. Cela part de Telegram, puis est repris sur X.

Du côté du gouvernement israélien, c’est assez différent. On a plutôt observé des techniques de publicité. Il y a la volonté de montrer ce qui se passe. Le gouvernement israélien a notamment publié des photos de bébés calcinés avec des messages d’avertissement. Ils ont aussi investi dans des moyens mis à disposition par les plateformes : des annonces publicitaires sur Twitter, Facebook, Youtube, des jeux vidéos (par exemple Candy Crush). En fait, ils ont investi la publicité pour raconter ce qu’il s’est passé, revenir sur les attaques du 7 octobre. On a observé des publicités venant directement du gouvernement israélien, du ministère des Affaires étrangères qui a acheté des espaces publicitaires sur les plateformes en ligne et sur des jeux vidéo.

Quels conseils donnez-vous aux utilisateurs des réseaux sociaux pour se protéger des fake news dans la période actuelle (et pour s’informer correctement)?

Malheureusement, cela est de plus en plus compliqué car ces fake news sont reprises par des comptes qu’on pouvait penser sérieux. Il y a quelques années, sur Twitter, un compte qui était certifié était gage de sérieux. Un député faisait attention à ce qu’il publiait. Aujourd’hui, on est dans un tel besoin de réactivité que les politiques veulent réagir tout de suite. Il y a une co‐intoxication entre les comptes non sérieux qui se font passer pour des comptes sérieux, les politiques qui veulent absolument satisfaire un électorat. Ce n’est pas parce qu’on a une information qui est largement diffusée qu’elle est vraie, ce n’est pas parce qu’on a une information qui vient d’un compte avec un badge bleu qu’elle est vraie, ce n’est pas parce qu’on a une information mise en ligne par un politique qu’elle est vraie …

Il faut essayer de recouper les sources à sa façon. Si on se dit qu’un média est potentiellement engagé, ou a une volonté militante, alors il faut multiplier les médias. Il faut lire des médias qui ont des équipes sur le terrain, des médias internationaux, des médias britanniques. Il faut essayer d’avoir le plus de sources possibles pour essayer d’y voir clair. Dans un conflit comme celui‐là, c’est extrêmement difficile. Honnêtement, pour le citoyen, on est à une période très compliquée. Je crois qu’il faut un retour aux fondamentaux.